Midjourney V8.1 Alpha : 2K natif, HD trois fois plus rapide et grammaire V7 retrouvée

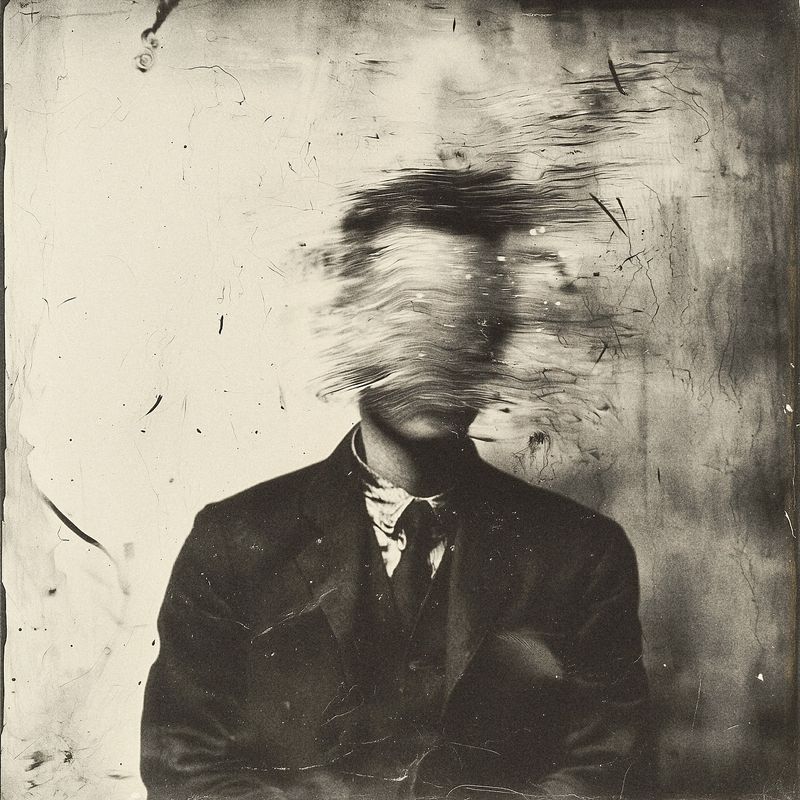

Ouverte le 14 avril sur alpha.midjourney.com, la version V8.1 Alpha ramène l’aspect visuel dans la continuité de V7 — les moodboards et les srefs redeviennent stables — après une V8 que la communauté trouvait trop rigide. Le mode HD est trois fois plus rapide et trois fois moins cher, la résolution standard est 50% plus rapide et 25% moins chère, et les images sont désormais générées en 2K par défaut sans passer par un upscale. L’interface alpha regroupe réglages, références image, profils de personnalisation et moodboards dans un seul panneau à droite de la barre d’Imagine — un geste que Midjourney n’avait pas osé depuis la migration Discord vers le web. Les productions V8.1 Alpha ne sont pas encore visibles dans la galerie publique ni dans Discord : l’environnement reste cloisonné pour absorber les itérations massives que l’équipe annonce sur les semaines à venir. Pour un directeur artistique qui cale une direction visuelle d’album, la bascule immédiate est esthétique : V8.1 rend de nouveau des images qu’on peut signer.

Le point qui compte dans cette mise à jour n’est pas la vitesse, c’est la correction de cap. V8 avait durci la signature Midjourney, et la base d’utilisateurs l’avait ressenti comme une perte — les workflows calibrés en V7 se brisaient sans raison visible. Revenir à une grammaire proche de V7 tout en accélérant le HD, c’est admettre que la stabilité esthétique prime sur la démonstration technique.

Le deuxième signal est plus discret : Midjourney cloisonne l’alpha hors de la galerie publique. La galerie était l’un des leviers de viralité les plus efficaces du produit. La retirer temporairement, c’est accepter de ralentir le marketing pour fiabiliser le modèle — un choix rare dans une concurrence qui pousse tout le monde à démo-logger en permanence.